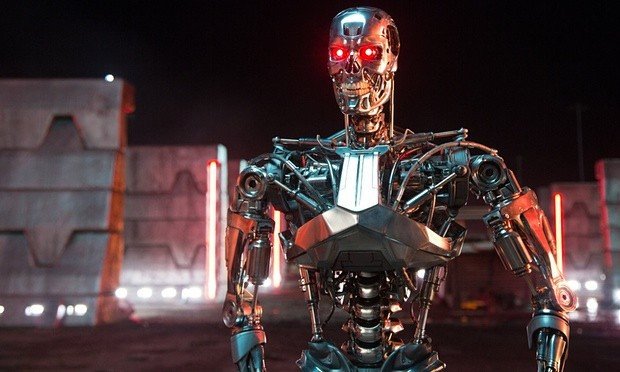

США создали и вскоре планируют обнародовать новую доктрину по модернизации вооруженных сил, которая будет включать, в частности, использование искусственного интеллекта (ИИ) и квантовых вычислений. Военные прогнозируют, что в ближайшие 10-15 лет примерно треть самых современных вооруженных сил мира будет роботизирована. Глава Объединенного комитета начальников штабов США Марк Милли во время пресс-конференции заявил — «Мы делаем это не для того, чтобы вести войну, а для того, чтобы ее сдержать».

По его словам, главная задача искусственного интеллекта – не лишить работы военных аналитиков, а сделать войну менее смертоносной. В настоящее время министерство обороны США уже экспериментирует с ботами с искусственным интеллектом, которые могут управлять модифицированным истребителем F-16. А в скором будущем робототехника будет играть все большую роль в беспилотных летательных аппаратах, морских судах и наземных транспортных средствах. Генерал Милли также рассказал о будущих беспилотных военно-воздушных силах, военно-морском флоте «без матросов» и танках без экипажа.

Сократится также время принятия решений – до нескольких минут вместо часов или дней. И тут ученые уже предостерегают от возможности чрезмерно полагаться на искусственный интеллект в части командования и контроля над вооружением, поскольку он работает с гораздо большей скоростью, чем люди. «Люди не должны никогда верить в то, что машины думают», — настаивают эксперты. Например, в отчете, который опубликовала Ассоциация контроля над вооружениями, говорится, что искусственный интеллект и другие новые технологии, такие как гиперзвуковые ракеты, могут привести к «размыванию разницы между обычной и ядерной атакой».

Марк Милли подчеркнул, что для США принципиальным является тот момент, что люди, а не компьютеры должны принимать решения о жизни или смерти во время войны. Политика страны – обеспечить возможность людям оставаться в цикле принятия решений.

Другое беспокойство противников ИИ состоит в том, что эта технология может позволить мошенникам или даже террористам получить засекреченную информацию по созданию грязных бомб или других смертоносных устройств. Значительная часть данных сегодня хранится частными компаниями, которые могут быть уязвимы для шпионажа, управляемого тем же искусственным интеллектом. Рассекречивание может также коснуться обнаружения мест размещения ядерного оружия, опасность чего слишком высока.

Пока эксперты и члены правительства обсуждают целесообразность использования искусственного интеллекта в процессе принятия военных решений, технология уже продемонстрировала свою пользу, в частности, как инструмент для предсказания российского вторжения в Украину. Модели на основе искусственного интеллекта дали «особо ужасный» и четкий прогноз того, что Россия начнет войну. Это было еще на том этапе, когда вероятность российского вторжения все еще обсуждалась в Вашингтоне и других западных столицах как теоретическая.

Что касается украинского контрнаступления, по которому также делали компьютерные расчеты, то Марк Милли заявил, что не удивлен тем, что оно происходит медленнее. Отвечая на вопрос о том, беспокоится ли он, что контрнаступление Украины не демонстрирует достаточного прогресса, Милли ответил: «Война на бумаге и настоящая война отличаются. На реальной войне гибнут настоящие люди».

Сейчас искусственный интеллект прогнозирует, например, географию вероятных ракетных ударов по украинским городам. Но главную роль все же продолжает играть разведка и другие инструменты, которыми традиционно пользуются вооруженные силы.

А бывший директор Объединенного центра искусственного интеллекта Пентагона Генерал-лейтенант Джек Шанахан заверил, что Минобороны США при всем интересе к возможностям ИИ не будет передавать машинам командование и управление. Главной задачей для ИИ, по его словам, остается повышение эффективности техники, чтобы спасать жизнь и помогать предотвращать войну.

В то же время вопрос состоит в том, будут ли другие страны соблюдать те же правила, что и Вашингтон. «Я не верю, что США пойдут по пути разрешения вещей… без человеческого контроля. Но я не уверен, что кто-нибудь другой может этого не сделать. Я считаю, что наибольшее беспокойство вызвало бы предоставление этой машине или объекту слишком много полномочий», — сказал Шанахан.